csv数据导入Hadoop中的HDFS

本文共 1928 字,大约阅读时间需要 6 分钟。

作者: lly

简介

本文介绍通过使用Hadoop命令的方式将csv数据导入进入HDFS中

一、环境准备

具体的环境准备及搭建流程可参考以下文章,本文不再做赘述

基础环境准备: Hadoop集群搭建:二、数据准备

未注册到 iServer的 csv 数据进行分布式分析服务,则需确保在 csv 存放目录下有与其对应的 .meta 文件,该.meta文件包含 csv 数据文件的元信息,所以我们将两个数据一起拷入。以示范数据 newyork_taxi_2013-01_14k.csv 为例,.meta 文件内容为:

"FieldInfos": [ { "name": "col0", "type": "WTEXT" }, { "name": "col1", "type": "WTEXT" }, { "name": "col2", "type": "WTEXT" }, { "name": "col3", "type": "INT32" }, { "name": "col4", "type": "WTEXT" }, { "name": "col5", "type": "WTEXT" }, { "name": "col6", "type": "WTEXT" }, { "name": "col7", "type": "INT32" }, { "name": "col8", "type": "INT32" }, { "name": "col9", "type": "DOUBLE" }, { "name": "X", "type": "DOUBLE" }, { "name": "Y", "type": "DOUBLE" }, { "name": "col12", "type": "DOUBLE" }, { "name": "col13", "type": "DOUBLE" } ], "GeometryType": "POINT", "HasHeader": false, "StorageType": "XYColumn" } 三、导入csv

1.首先将数据放到opt目录下

- newyork_taxi_2013-01_14k.csv

- newyork_taxi_2013-01_14k.meta

2.将示例数据导入到 hdfs 中,启动 hadoop,在 hadoop-2.7.7/bin 中执行

./hadoop fs -mkdir /input #创建/input 目录./hdfs dfs -put /opt/newyork_taxi_2013-01_14k.csv /input/ #将 taxi 数据导入到/input 目录中./hdfs dfs -put /opt/newyork_taxi_2013-01_14k.meta /input/

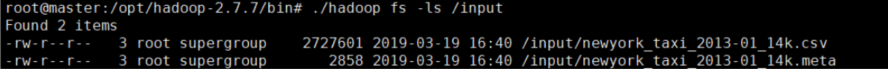

3.导入完成后,可以使用如下命令查看

./hadoop fs -ls /input

4.输出结果如下

5.也可通过访问文件系统的方式来查看,访问ip:50070(ip为Hadoop所在机器的ip),并选择刚才创建的文件夹

5.也可通过访问文件系统的方式来查看,访问ip:50070(ip为Hadoop所在机器的ip),并选择刚才创建的文件夹

至此,我们已成功将csv数据导入Hadoop的HDFS中。我们后续会发布更多有关SuperMap大数据平台的专题。

至此,我们已成功将csv数据导入Hadoop的HDFS中。我们后续会发布更多有关SuperMap大数据平台的专题。 转载地址:http://anvxi.baihongyu.com/

你可能感兴趣的文章

TortoiseSVN 1.7.0以上版本的重大变化

查看>>

软件研发行业前景

查看>>

软件工程文档 总结

查看>>

设置默认的调试器(VC6 or VS2008)

查看>>

Windows8内核将一统PC、平板和手机系统

查看>>

员工求生存与发展

查看>>

面试技巧:16个经典面试问题回答思路

查看>>

内部排序算法的比较和实现

查看>>

马无夜草不肥:程序员做业余项目的重要性

查看>>

IDE集成开发环境

查看>>

程序异常时,关闭Visual Studio 2008 实时调试器

查看>>

Windows 8应用开发书籍汇总

查看>>

如何保障晚间的高效工作

查看>>

Windows平台的SDK、DDK与WDK

查看>>

libxml2-xml 开源库解析工具(依赖libiconv、zlib库)

查看>>

Windows下zlib库和libPng库的编译和使用

查看>>

获得心灵安宁的7个技巧

查看>>

工厂模式的c++描述

查看>>

锻炼思维小题目

查看>>

DLL/EXE查看工具Dumpbin

查看>>